Recrear escenas imaginarias o diseñar un personaje desde cero con solo escribir una frase es, desde hace unos días, parte de lo que se puede hacer directamente en ChatGPT, el popular chatbot de inteligencia artificial que parece cambiar semana a semana la forma como interactuamos con la tecnología.

La nueva función integrada de generación de imágenes, bautizada como GPT-4o image generation, transforma simples instrucciones de texto (prompts) en ilustraciones detalladas y sorprendentemente parecidas a lo que haría una mano humana.

¿Cómo funciona esta tecnología?

A diferencia de versiones anteriores, como DALL·E 3, esta herramienta no está separada del modelo de lenguaje. “La generación de imágenes ahora es nativa de GPT-4o”, señaló el equipo en su blog oficial. Esto significa que el modelo puede crear, refinar y ajustar una imagen en el mismo hilo de conversación, recordando lo que el usuario dijo antes o incluso reutilizando partes de otras imágenes cargadas.

“Puedes refinar imágenes mediante una conversación natural”, explicaron. “GPT-4o puede construir sobre imágenes y texto en el contexto del chat, garantizando consistencia a lo largo del proceso”.

Esa coherencia se nota especialmente cuando se diseñan personajes, paisajes o escenas que deben mantenerse estables en múltiples versiones. A diferencia de otros sistemas que “luchan con 5 a 8 objetos simultáneos”, GPT-4o puede manejar “entre 10 y 20 elementos distintos con precisión”, gracias a lo que llaman un “enlace más ajustado entre objetos, rasgos y relaciones”.

La calidad de los resultados no se basa solo en el volumen de datos con los que fue entrenado, sino también en la forma como el modelo aprendió. “Entrenamos nuestros modelos en la distribución conjunta de imágenes y texto en línea, aprendiendo no solo cómo se relacionan con el lenguaje, sino cómo se relacionan entre sí”, detalló OpenAI. Eso le dio al modelo una “fluidez visual sorprendente”, capaz de generar imágenes “útiles, consistentes y conscientes del contexto”.

El conocimiento general que tiene GPT-4o también le da ventaja: puede generar imágenes más informadas. “La generación de imágenes nativa permite a GPT-4o vincular su conocimiento entre texto e imágenes, dando como resultado un modelo que se siente más inteligente y eficiente”.

Otro punto clave es su capacidad para interpretar imágenes cargadas por el usuario. “GPT-4o puede analizar y aprender de imágenes subidas por el usuario, integrando sin problemas sus detalles en el contexto para informar la generación de imágenes”, dice el documento técnico.

Este, a la final, es el detalle clave de la nueva moda en redes sociales, pues ahora el chatbot permite que se diseñen variaciones de un retrato, recrear escenarios en base a una foto de referencia, o combinar elementos con precisión según las instrucciones dadas.

La personalización también es parte del paquete: se pueden solicitar colores exactos (usando códigos hexadecimales), definir relaciones espaciales, o pedir aspectos técnicos como fondos transparentes. La plataforma, sin embargo, advierte que las imágenes pueden tardar hasta un minuto en renderizarse debido al nivel de detalle que alcanza el modelo.

Todas las imágenes generadas por GPT-4o incluyen metadatos C2PA “para identificar que provienen del modelo y brindar transparencia”. Además, los contenidos pasan por filtros automáticos.

“Bloqueamos solicitudes que puedan violar nuestras políticas de contenido, como materiales de abuso sexual infantil o deepfakes sexuales”, indica el documento. “Cuando hay imágenes de personas reales en el contexto, tenemos restricciones reforzadas sobre qué tipo de contenido puede crearse, con protecciones particularmente sólidas en torno a la desnudez y la violencia gráfica”.

OpenAI también usó un modelo de razonamiento, conocido como reasoning LLM, para ayudar a moderar el contenido en tiempo real y refinar sus políticas. “Lo entrenamos directamente a partir de especificaciones de seguridad escritas por humanos. Lo usamos durante el desarrollo para identificar ambigüedades en nuestras políticas y abordarlas”, explicaron.

Así, mientras las redes sociales se llenan de retratos nostálgicos “estilo Ghibli”, personajes de videojuegos, mascotas convertidas en pinturas y afiches publicitarios generados en segundos, en el fondo hay una arquitectura de inteligencia artificial que no solo entiende lo que decimos, sino que lo dibuja. Y que cada vez lo hace mejor.

Sin embargo, esta nueva moda ha desatado un nuevo debate sobre legalidad, uso de propiedad intelectual e incluso los límites éticos de esta tecnología.

IA, artistas y la frontera legal del estilo

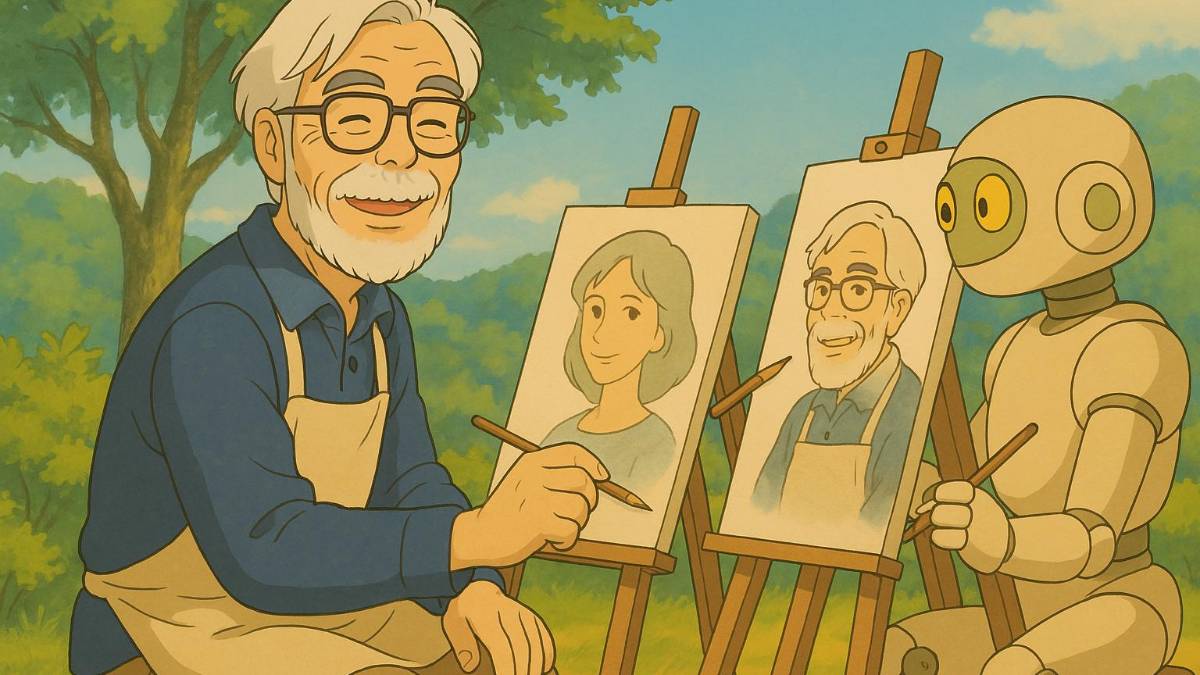

Durante la última semana, redes sociales como X, Instagram y TikTok se llenaron de imágenes que parecían haber salido directamente de películas como Mi vecino Totoro o El viaje de Chihiro. Pero no eran fotogramas de Studio Ghibli, ni tampoco ilustraciones firmadas por Hayao Miyazaki, sino fotos personales, memes y escenas de actualidad recreadas con este nuevo generador de imágenes de ChatGPT. La fiebre fue tal que hasta Sam Altman, CEO de la compañía, publicó su retrato en versión “ghiblificada”.

¿Pero hasta qué punto es válido recrear el estilo visual de un estudio o de un artista sin su consentimiento? ¿Y qué hace OpenAI para evitar problemas?

La tecnológica ha implementado filtros que bloquean automáticamente la generación de imágenes cuando se menciona el nombre de un artista vivo, una película registrada o una marca reconocida. Añade una negativa automática si el usuario escribe instrucciones como “hazlo al estilo de Hayao Miyazaki” o “crea una imagen tipo Pixar”. En teoría, eso debería proteger los derechos de autor.

Sin embargo, los usuarios han aprendido a esquivar estos límites. Basta con reformular la instrucción como “en el estilo de animación japonesa de los años 80” o “una imagen con colores cálidos, líneas suaves y fantasía infantil” para obtener un resultado que remite directamente al universo de Studio Ghibli.

Como reconoce el propio documento técnico de OpenAI, sí se permiten “estilos de estudio más amplios”, bajo el argumento de que esto impulsa “creaciones originales verdaderamente inspiradas y encantadoras”.

¿Pero dónde termina la inspiración y comienza la copia? “Si se genera una imagen que incluye elementos sustancialmente similares a obras protegidas por derechos de autor, puede haber un problema”, advirtió el abogado Josh Weigensberg, citado por la agencia AP. “La idea de que el estilo no es protegible no cierra el debate. A veces lo que la gente llama ‘estilo’ en realidad son combinaciones específicas de elementos visuales que sí están protegidos”.

Esa preocupación también es compartida dentro del propio Studio Ghibli. En una entrevista reciente concedida a la AFP, Goro Miyazaki, hijo de Hayao Miyazaki y actual director de animación del estudio, fue tajante: “No sería sorprendente que, dentro de dos años, una película (de animación) sea realizada completamente por la IA”.

Y aunque reconoció el potencial de esta tecnología para descubrir talentos inesperados, también se mostró escéptico sobre su impacto creativo. “¿El público estaría dispuesto a ver una película completamente generada por IA?”, se preguntó.

Las dudas no son nuevas. En 2016, durante el rodaje de un documental de la cadena japonesa NHK, el propio Hayao Miyazaki fue confrontado con una animación grotesca generada por IA. Su reacción fue inmediata: “Esto es un insulto a la vida misma”, dijo.

Esa frase, que resurgió con fuerza tras la viralización de las imágenes generadas por GPT-4o, se ha convertido en un símbolo del choque entre la sensibilidad artística y la eficiencia algorítmica.

La posición oficial de Studio Ghibli, sin embargo, ha sido el silencio. Consultados por AP sobre el fenómeno, el estudio declinó hacer comentarios y, hasta el momento, no hay evidencia de que OpenAI haya usado directamente sus películas para entrenar su modelo.

Lea también: ¿Qué dijo Miyazaki sobre la IA? Una crítica de 2016 revive en pleno furor de imágenes creadas con ChatGPT

Lo que sí queda claro es que el sistema aprendió lo suficiente —ya sea por inferencia o por imágenes públicas disponibles— como para replicar con notable fidelidad una estética reconocible en todo el mundo.

El blog técnico de OpenAI asegura que han implementado un sistema interno de búsqueda para verificar si una imagen fue producida por sus modelos. Pero más allá de las barreras técnicas, el debate de fondo sigue siendo cultural: ¿es legítimo apropiarse del estilo de otro creador, aunque no se mencione su nombre?

Goro Miyazaki lo resume así: “Si Hayao Miyazaki y Toshio Suzuki ya no pueden hacer animación, ¿qué pasará entonces? No es como si pudieran ser reemplazados”. A pesar de que su padre, con 84 años, acaba de ganar un Óscar por El niño y la garza, su legado parece más frágil que nunca frente al avance de la inteligencia artificial.

La huella ambiental de usar IA

Esta fascinación por recrear fotos al estilo Ghibli no solo desató un fenómeno cultural en redes sociales, también encendió las alertas sobre los costos invisibles de esta nueva forma de entretenimiento.

No se habla únicamente de ética o derechos de autor, sino también del impacto ambiental, huella energética y seguridad digital. ¿Quién paga el precio de una imagen generada por inteligencia artificial?

“Las IA no son mágicas”, advierte Leonardo Betancur Agudelo, PhD. en Ingeniería e investigador de la Universidad Pontificia Bolivariana. “Lo que hay detrás son servidores construidos con microprocesadores que generan calor y necesitan sistemas de enfriamiento sofisticados. Eso consume energía, y mucha”. De hecho, el catedrático explica a EL COLOMBIANO que un centro de datos pequeño puede requerir entre 200 mililitros y cinco litros de agua por kilovatio-hora solo para refrigerarse.

Multiplicado por millones de solicitudes diarias, el impacto se dispara: “Estamos hablando de millones de litros de agua al año para enfriar equipos que, en muchos casos, se usan solo para entretenimiento”.

El ejemplo más claro fue el boom de estos días con la “ghiblificación” de imágenes con ChatGPT. Según Betancur, los modelos de alta capacidad fueron exigidos al máximo: “Esos servidores colapsaron por el tráfico y comenzaron a operar a tope, lo que genera emisiones de cientos de toneladas de CO₂. Entrenar un modelo como GPT-3 consumió 1.200 megavatios-hora y emitió más de 500 toneladas de CO₂. Esa es la huella de carbono de una sola IA”.

Desde su perspectiva, no se trata de renunciar a la tecnología, sino de asumirla con responsabilidad. “¿Queremos usar estas capacidades para resolver problemas humanos complejos o solo para pasar el rato? Incluso el ocio tiene un costo ambiental. Y hay que decidir si vale la pena”.

Pero la huella no es solo ecológica, también es digital y muchas veces peligrosa. Así lo señala Wilson Calderón, gerente técnico para Latinoamérica de ManageEngine.

“Los usuarios desconocen el tratamiento de datos personales que realizan estas herramientas. Están entregando datos biométricos que son usados como métodos de autenticación en entornos bancarios, clínicos o académicos. Es urgente reflexionar sobre qué información entregamos, a quién y para qué”, comentó a este medio.

Calderón advierte que el simple acto de subir una foto puede poner en riesgo la privacidad del usuario y, en el peor de los casos, facilitar actividades delictivas. “Detrás de una tendencia viral hay empresas recolectando información y gobiernos que aún no han legislado el tema”.

Mónica Vargas, máster en Inteligencia Artificial, coincide en el análisis: “Cuando el usuario usa estas herramientas de forma gratuita, el producto es el usuario. Sus datos pueden ser vendidos para publicidad, pero también para crear perfiles que faciliten ataques a su identidad digital”.

La experta advierte especialmente sobre el uso de imágenes de niños y niñas. “A veces, los padres o tutores están entregando datos sin saberlo. En algunos casos, estas fotos han terminado en redes de pornografía infantil. Puede sonar extremo, pero es un riesgo real”.

El panorama plantea preguntas urgentes: ¿qué pasa con los datos biométricos que subimos a plataformas de IA? ¿Quién los regula? ¿Cómo se almacenan? En Colombia, la legislación sobre inteligencia artificial es prácticamente inexistente, lo que deja a los usuarios en un limbo legal.

Por eso, concluyen los expertos, el llamado no es al pánico sino a la conciencia. Generar imágenes con IA puede ser fascinante, pero también tiene un costo. Aunque este no aparezca en pantalla, puede ser ambiental, ético e incluso personal.

Regístrate al newsletter

Regístrate al newsletter